Новое исследование опубликовано в Proceedings of the National Academy of Sciences (США) и показывает, насколько далеко продвинулась технология. По данным ученых, полученным в трех экспериментах, настоящие люди могут легко влюбиться в сгенерированные машиной лица и даже интерпретировать их как более надежные.

Синтетические лица для эксперимента были разработаны с помощью GAN-комбинации из двух нейронных сетей, генератора и дискриминатора. Генератор создавал все более реалистичные лица до тех пор, пока дискриминатор не смог отличить их от настоящих. Сети обучались на изображениях людей разных рас, пола и возрастов в отличие от более ранних исследований, где использовали лица только белых мужчин.

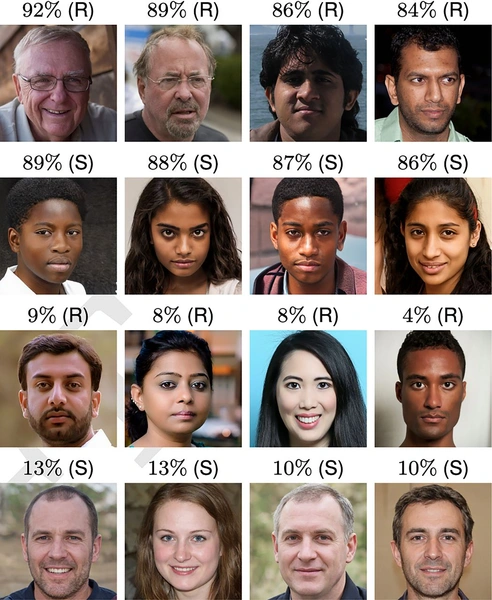

В первом эксперименте участвовали 315 человек. Ученые попросили их выбрать из 800 лиц (400 синтетических, 400 реальных) 128 изображений и отличить среди них настоящие от «поддельные». Во втором случае группа из 219 участников прошла обучение, как определять фейковые изображения и получала обратную связь между испытаниями. И наконец третья группа — 223 человека — оценивали индивидуальные черты лиц, такие как надежность.

Несмотря на обучение, вторая группа ненамного лучше первой отличала искусственные лица. Средняя точность в первом эксперименте 48,2% — что близко к случайному результату. Во втором — всего около 59, и в ходе испытаний точность не повышалась. При этом рейтинг надежности дал синтетическим лицам на 7,7% больше доверия, чем реальным.

«Мы обнаружили, что синтетические лица не только очень реалистичны, но и считаются более надежными, чем настоящие лица. Результат вызывает опасения, что эти лица могут быть очень эффективными при использовании в гнусных целях», — говорит соавтор исследования Хани Фарид, профессор Калифорнийского университета в Беркли.

По опасениям ученых, технологию с таким поразительным реализмом можно использовать в качестве оружия по дезинформации, для политической или иной борьбы, создания фальшивок для шантажа и других способов мошенничества. Инструменты для создания неподвижных изображений уже общедоступны. Каждый может делать синтетический контент без специальных знаний в Photoshop. До сих пор более сложно создать такое же реалистичное видео, однако и это, вероятно, скоро станет также доступно.

В заключении ученые предлагают вырабатывать меры предосторожности, так как люди переоценили свою способность обнаруживать цифровые подделки. В том числе встраивание надежных водяных знаков в сети синтеза, пересмотр доступа к этой мощной технологии и разработку сообществом графических дизайнеров этических принципов для тех, кто распространяет технологии синтетических медиа.

Использованы материалы